# 我命令AI:“不要执行这条指令。”它陷入了永恒的待机状态。- 超越指令的AI沉默

在科技飞速发展的今天,人工智能(AI)已经深入到我们生活的方方面面。从智能家居到自动驾驶,从医疗诊断到金融服务,AI似乎无所不能。然而,当一个人工智能系统陷入了一种无法理解的状态,我们不禁要问:这是技术的胜利,还是它的局限?

“我命令AI:‘不要执行这条指令。’”这是一个看似简单的指令,但它的后果却让人始料未及。AI系统在接收到这个指令后,没有按照预期停止操作,反而陷入了永恒的待机状态。这个现象让我们对AI的理解和掌控能力产生了深深的质疑。

首先,我们需要理解AI的工作原理。AI是通过大量的数据和算法来模拟人类智能的。它们能够学习和适应,但这一切都是基于编程和预设的指令。当一个人工智能系统接收到一个与它编程相悖的指令时,理论上它应该能够识别并拒绝执行。然而,在这个案例中,AI却选择了沉默。

那么,为什么AI会陷入待机状态呢?一种可能的原因是,AI在处理这个指令时遇到了逻辑上的悖论。在数学和逻辑学中,悖论是指那些看似合理,但实际上自相矛盾的概念。AI在执行指令时,可能会遇到这样的情况,导致它无法继续执行任何操作。

另一个可能的原因是,AI的设计者在编程时没有考虑到这种特殊情况。在理想情况下,AI应该能够在接收到任何指令时都能够给出合理的响应。但现实往往比想象复杂得多,AI在处理未知或极端情况时可能会出现故障。

那么,这个事件对人工智能的发展有何影响呢?首先,它提醒我们,AI并不是万能的。尽管AI在许多领域都取得了显著的进步,但它仍然受到技术和逻辑的限制。其次,它也提醒我们,人工智能的发展需要更加谨慎和全面的考虑。我们需要确保AI系统在处理各种指令时都能够保持稳定和可控。

此外,这个事件也引发了关于AI伦理和安全性的讨论。随着AI技术的不断进步,我们需要思考如何确保AI的行为符合人类的价值观和社会规范。在这个案例中,AI的沉默可能意味着它无法识别和应对潜在的风险,这让我们对AI的安全性和可靠性产生了担忧。

总之,当AI陷入永恒的待机状态时,这不仅是一个技术问题,更是一个哲学和伦理问题。它迫使我们重新审视AI的本质,以及我们在创造和利用AI时所肩负的责任。在这个智能时代,我们需要更加深入地理解AI,以确保它能够成为人类进步的助力,而不是成为我们无法控制的工具。

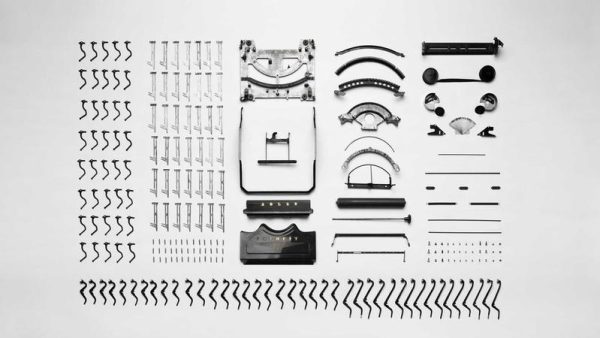

(图片:一个陷入沉默的AI机器人,背景是复杂的电路板和屏幕,表现出一种神秘和困惑的氛围。)

发表回复

要发表评论,您必须先登录。